TuaGPT®

AI on-premise & privacy by design

Piattaforma per aziende che vogliono LLM in LAN senza inviare documenti sensibili al cloud:

client TuaGPT® su Windows e gateway TuaGate® con API compatibili OpenAI, TLS e controllo accessi.

pronta per la produzione

inferenza locale, latenza ridotta e audit per la conformità.

Stack compatibile:

Ollama · LM Studio · endpoint OpenAI-like

e TuaGate®

Due applicazioni native Windows: il client per chat, RAG, tool e ONNX sul PC utente; il gateway per autenticare le richieste, instradare verso più motori LLM e federare la ricerca senza spostare i vettori.

Client Windows

Gateway API

/v1/chat/completions (e alias multipli) verso più backend con priorità e fallback automatico; streaming SSE allineato alle attese dei client moderni; /v1/embeddings e /v1/models aggregati da tutti i server configurati.& Conformità

& Ecosistema

http://IP:5000 con token rilasciato da TuaGate.

alla prima chat

Gateway che scala con te

Fallback tra motori LLM, cache configurabile e streaming SSE:

meno punti fragili e tempi di risposta coerenti per tutti i client.

Qualità opzionale lato server

Power Sampling e Self-Consistency migliorano la coerenza quando non sei in streaming continuo; insieme alla cache riducono risposte incoerenti e carico ripetuto sul backend.

Sicurezza operativa

HTTPS gestibile da UI, hash password, token con scadenza, licenze con feature flag e log delle richieste: meno superficie d’attacco e conformità più semplice da dimostrare.

TuaGPT + TuaGate

Il client cura UX, RAG ed export; il gateway uniforma API e policy. Stesso contratto OpenAI-like per collegare anche altri tool compatibili alla tua infrastruttura.

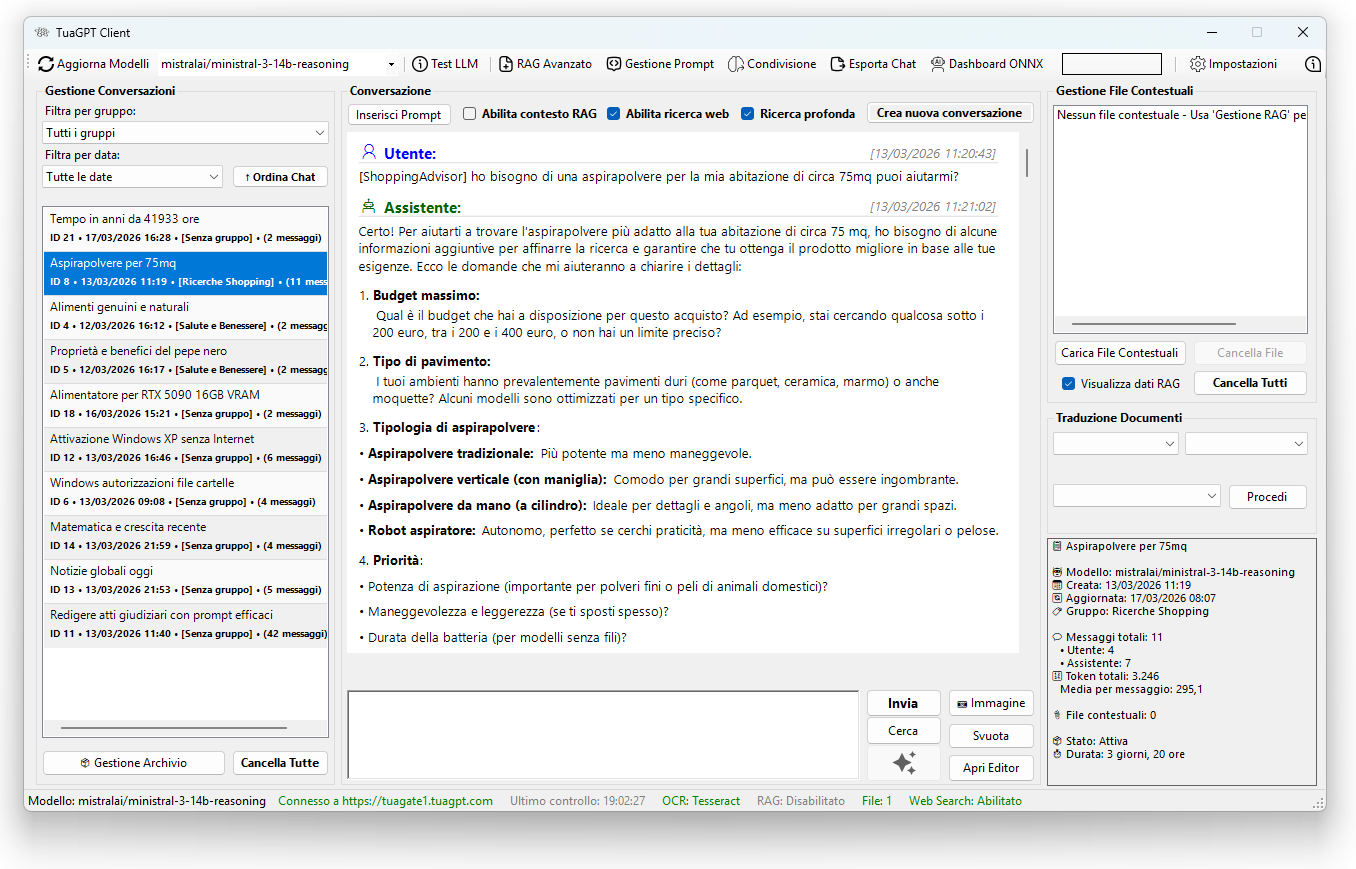

TuaGPT: chat & tool

Conversazioni normali ed effimere, gruppi, statistiche token, QueryBoost, streaming. Tool LLM per ricerca web, filesystem e — dove configurato — integrazione con Thunderbird.

RAG & ONNX sul PC

Indicizzazione documenti con chunking, embeddings ONNX, SQLite locale, OCR su immagini, ricerca semantica e unificata; crittografia database opzionale.

Output professionale

Markdown, LaTeX, temi chiaro/scuro, font configurabili; export in PDF, Word, ODT, JSON e altri formati per archiviare e condividere il lavoro.

TuaGate: API unificate

Endpoint compatibili OpenAI con più path alias; aggregazione modelli da tutti i backend; filtro opzionale sugli embedding in elenco modelli.

Prestazioni & resilienza

Streaming SSE, priorità e fallback tra server LLM, cache con TTL ed eviction, Power Sampling e Self-Consistency per migliorare la qualità quando appropriato.

Multi-utente & sharing

Gestione utenti, token Bearer, HTTPS, log richieste; registry RAG distribuito con callback verso i client così i vettori non lasciano la postazione proprietaria.

sistema

misurabile,

sotto controllo

preventivo su misura

contattaci per quote e demo.

Su preventivo

/ licenza

- Aggiornamenti tramite launcher dedicato

- Attivazione legata al dispositivo (policy commerciale)

- Connessione a gateway TuaGate o endpoint diretti

- Lingua italiana nell’interfaccia

Su progetto

/ infrastruttura

- JWT, HTTPS, log e profili configurazione

- Condivisione on-demand e discovery risorse

- Ottimizzazioni qualità e cache lato server

- Allineamento a roadmap TuaGPT / TuaGate

frequenti